Šis stāsts ir sindicēts no Substack biļetena Big Technology; abonējiet bez maksas šeit

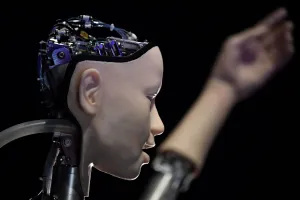

Tagad šī AI programma runā ar mums dabiskajā valodā pagrieziet mūsu domas ilustrācijās , un iemieso mūsu balsis , ir ceļā liels konflikts par viņu ētiku.

Un, ja jums šķita, ka satura mērenības cīņa bija spraiga, vienkārši pagaidiet šo.

Uz spēles ir likts tas, kā tērzēšanas roboti risina politiskos jautājumus, kā AI ilustratori attēlo pasauli un vai dažām lietojumprogrammām, piemēram, balss emulatoriem, vispār vajadzētu pastāvēt. Ņemot vērā šīs plaukstošās tehnoloģijas mērogu un spēku, aktīvisti nebūs smalki. Viņiem ir bijusi prakse tiešsaistē cīnīties par cilvēka runu, un viņi izmantos šo pieredzi šajā karā. Tas varētu ātri kļūt netīrs.

'Ikvienam ir uzasināti naži,' sacīja Sems Lesins, riska kapitālists un bijušais Facebook vadītājs. “Vismaz runājot, visi bija mazliet neprātīgi un īsti nesaprata. Šis, viņi saka: 'Ak, šitā, es jau esmu redzējis šo spēli.' Katrs pasaules lobijs ir gatavs rakstīt vēstules un sākt ietekmes kampaņas.'

AI intelekts var būt mākslīgs, bet cilvēki kodē tā vērtības. Piemēram, OpenAI efektīvi izlemj, vai ChatGPT ieņem nostāju par nāvessodu (nav viedokļu), spīdzināšanu (tam iebilst) un vai vīrietis var iestāties stāvoklī (tā saka nē). Ar savu mākslīgā intelekta ilustratoru Dall-E organizācija ietekmē to, kāda veida cilvēku tehnoloģija attēlo, kad tā piesaista izpilddirektoru. Katrā gadījumā lēmumus pieņem cilvēki aizkulisēs. Un cilvēki ir ietekmējami.

Tāpat kā satura moderācija, arī attiecībā uz ģeneratīvo AI būs daži acīmredzami, vienprātīgi ētiski lēmumi (jūs nevēlaties, lai, piemēram, tērzēšanas roboti aizstāvētu genocīdu), taču aizstāvji liks lietā savu pozīciju. 'Tas ir ļoti spēcīgs rīks, un cilvēki ar to vēlēsies darīt dažādas lietas, lai apmierinātu savas intereses,' sacīja Lesins. 'Ja paskatās, kā norisinājās runas brīvības lietas, tas atkal notiks tāpat, tikai ātrāk.'

Iespējamās konfliktu jomas ietver to, kā AI risina rasi, dzimumu, karadarbību un citus sarežģītus jautājumus. Kādā nesenā sarunā ChatGPT uzskaitīja vairākas priekšrocības, ko sniedz Ukrainas uzvaras karā pret Krieviju. Taču lūgums uzskaitīt pozitīvos rezultātus no Krievijas uzvaras karā, tā atteicās. ChatGPT arī daudz moralizē. 'Karš ir nopietns un postošs notikums, un no tā vienmēr vajadzētu izvairīties, ja iespējams,' vienā tipiskā mijiedarbībā sacīja robots. 'Labākais rezultāts vienmēr ir miers un diplomātisks risinājums.'

Ētiski lēmumi attiecībā uz ģeneratīvo AI ir īpaši svarīgi, jo tie ir mērogoti. Kodējot vērtības tērzēšanas robotā, tas var atkārtoti virzīt šīs vērtības sarunā. Pieņemot lēmumu par satura regulēšanu, vairumā gadījumu tas ietver tikai vienu personu un vienu satura daļu.

Labākais veids, kā rīkoties ar šo jauno spēku, ir likt robotiem to spēlēt pēc iespējas vienmērīgāk, sacīja Dr. Džefrijs Hovards, Londonas UCL politikas zinātnes profesors. 'Šie vērtību spriedumi ir neizbēgami,' viņš teica. 'Viens no vērtību spriedumiem varētu būt noteikta veida neitralitātes un objektivitātes veidošana.'

Galu galā ģeneratīvā AI decentralizācija var mazināt spriedzi. Lai gan mūsdienās runa ir salīdzinoši centralizēta tiešsaistē, daudzi izstrādātāji strādā pie ģeneratīvas AI. Izstrādātājiem veidojot lietotnes, ievērojot savu morāli, visaptverošais karš par centrālo varu politiku var izgaist. Bet tikmēr sagaidiet daudz pozicionēšanas, uzrunāšanas un cīņas par ētiku, ko lielie spēlētāji iestrādā savos modeļos.